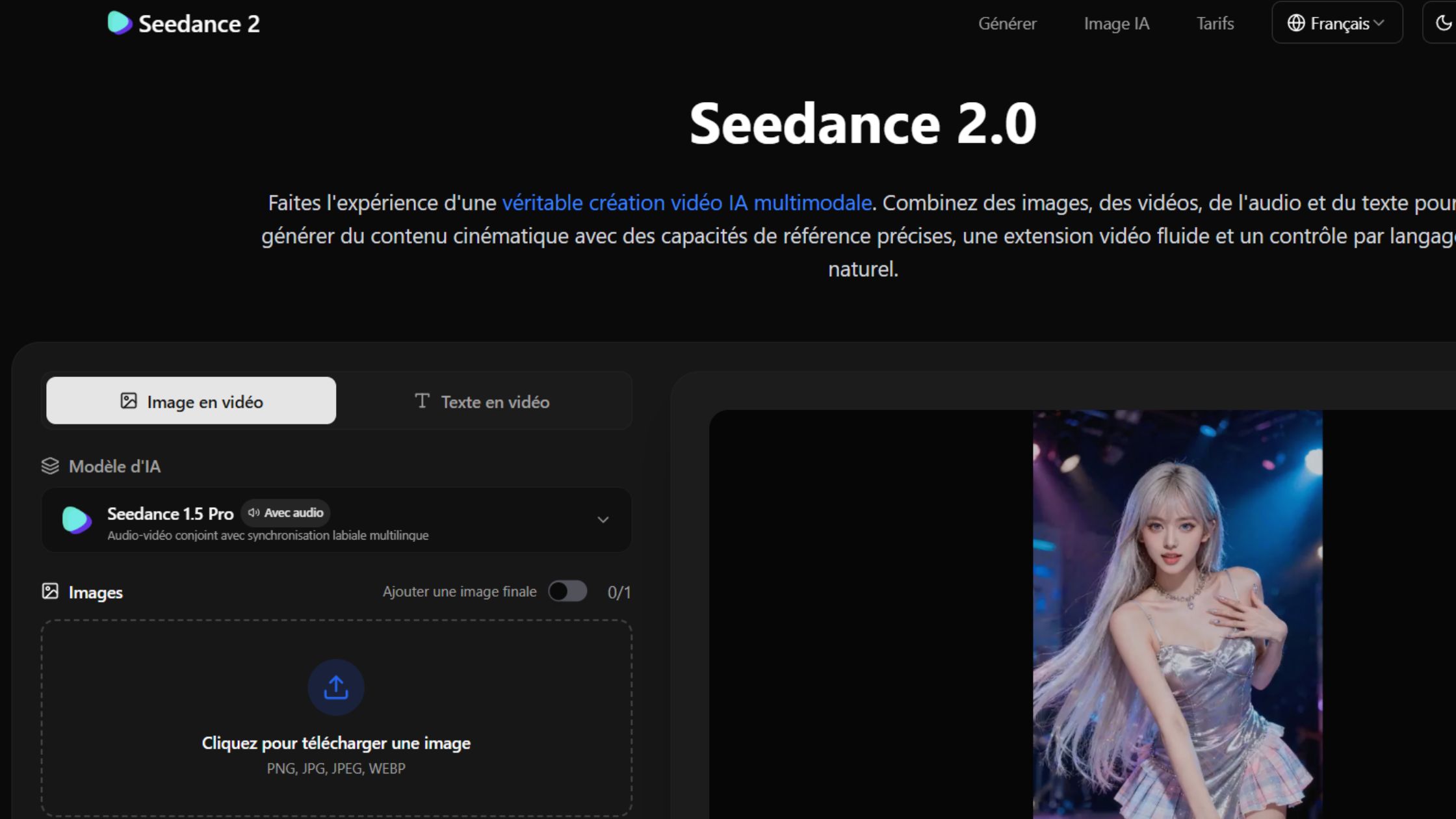

Seedance 2.0

Seedance 2.0 s’impose comme l’un des modèles de génération vidéo par IA les plus ambitieux de 2026. Développé par ByteDance, le géant technologique derrière TikTok, il repose sur une architecture multimodale capable de produire vidéo et audio simultanément. Résultat : des séquences cinématographiques cohérentes, générées à partir d’une simple phrase ou d’une image.

Découvrir Seedance 2.0

Seedance 2.0 est le modèle phare de la famille « Seed » de ByteDance, lancé en février 2026. Il se distingue de ses concurrents directs comme Sora 2, Runway Gen-4 ou Veo 3 par une approche multimodale complète. En effet, il accepte jusqu’à 12 ressources en entrée simultanée : images, vidéos, fichiers audio et texte. L’objectif affiché est clair — offrir un contrôle de niveau réalisateur sans compétences techniques avancées.

Fonctionnalités clés

Génération multimodale tout-en-un

Seedance 2.0 accepte texte, images, vidéos et audio comme sources d’entrée. Ainsi, vous pouvez combiner une photo de personnage, une vidéo de référence pour le mouvement et une piste audio, le tout dans une seule génération. Le modèle comprend automatiquement le rôle de chaque élément et maintient la cohérence visuelle.

Audio natif synchronisé

C’est l’un des points forts majeurs de Seedance 2.0. L’audio est généré en même temps que la vidéo, sans traitement en post-production. Dialogues avec lip-sync précis, effets sonores contextuels, musique alignée sur le rythme : tout est produit en une seule passe. Cette approche le rapproche de Sora 2, tout en proposant des tarifs plus accessibles.

Cohérence multi-plans et storytelling

Seedance 2.0 génère des séquences multi-plans cohérentes, où les personnages, le style visuel et l’atmosphère restent stables d’un plan à l’autre. C’est pourquoi il convient particulièrement à la narration longue ou aux vidéos publicitaires structurées. Fini le « character drift » qui affecte de nombreux autres modèles IA.

Contrôle de caméra de niveau réalisateur

L’outil permet de répliquer des mouvements de caméra à partir d’une vidéo de référence. Travellings, plans fixes, changements d’angle : vous montrez au modèle ce que vous voulez, et il l’applique à votre contenu. De plus, le système @ tagging (disponible sur Artlist et Dreamina) permet de baliser précisément les références visuelles dans le prompt.

Résolution et formats

Les vidéos sont générées en 1080p à 2K, sur des durées de 4 à 15 secondes. Plusieurs ratios sont supportés : 16:9, 9:16, 4:3, 1:1, 21:9. Cela couvre aussi bien les formats YouTube que les Reels ou les productions cinématographiques.

Cas d’usage

Créateurs de contenu social : générer rapidement des clips pour TikTok, Reels ou YouTube Shorts, avec synchronisation beat et cohérence visuelle entre les plans. Le gain de temps est significatif.

Équipes marketing et publicité : produire des vidéos promotionnelles multi-plans avec personnages, ambiances et audio, sans faire appel à une équipe de production complète. Seedance 2.0 permet de scaler la production de contenus visuels.

Réalisateurs et storyboarders : tester des angles de caméra, des rythmes de narration et des transitions avant une production réelle. L’outil réduit les risques créatifs en phase de conception.

Enseignants et formateurs : transformer des scripts et visuels en vidéos pédagogiques structurées, avec audio synchronisé. Le montage automatique permet de se concentrer sur le contenu.

Développeurs et studios : intégrer Seedance 2.0 via API (disponible sur BytePlus, WaveSpeedAI, Replicate) dans des workflows de production automatisés ou des applications tiers.

Tarifs

Seedance 2.0 est accessible gratuitement avec des crédits limités via l’app Xiaoyunque (ByteDance) ou Dreamina (225 tokens quotidiens partagés). L’abonnement payant démarre à environ 69 RMB/mois (soit environ 9,60 USD) sur la plateforme Dreamina/Jimeng, ce qui en fait l’un des modèles vidéo IA les moins chers du marché haut de gamme. Des plans plus avancés, ainsi qu’un accès API via des plateformes tierces, sont disponibles à des tarifs variables.

À noter : l’accès reste principalement centré sur les plateformes chinoises de ByteDance. Les utilisateurs internationaux passeront par des services tiers comme WaveSpeedAI, Artlist ou ImagineArt.

Points forts et limites

Points forts

- Génération audio et vidéo simultanée, sans post-production

- Cohérence des personnages remarquable sur plusieurs plans

- Tarif d’entrée très compétitif face à Sora 2 ou Runway

- Support multimodal jusqu’à 12 assets en entrée

- Résolution 1080p à 2K avec ratio flexible

- Taux de réussite des générations supérieur à 90% selon les benchmarks internes

Limites

- Accès international encore fragmenté (plateformes principalement en chinois)

- Durée maximum de 15 secondes par génération

- Pas encore de déploiement en API public stable à l’international

- Les interfaces tierces (Artlist, WaveSpeedAI) ajoutent un coût supplémentaire

- Modèle très récent (février 2026) : peu de retours d’expérience long terme disponibles

Notre recommandation

Seedance 2.0 est une avancée réelle dans la génération vidéo par IA. Son approche multimodale avec audio natif le distingue nettement des outils classiques. Toutefois, les utilisateurs francophones devront passer par des plateformes intermédiaires pour y accéder confortablement. Si vous produisez du contenu vidéo régulièrement et cherchez un rapport qualité/prix difficile à égaler en 2026, Seedance 2.0 mérite clairement votre attention.

Mise à jour : février 2026